等了快三个月,DeepSeek V4终于官宣了。

2026年4月24号上午,DeepSeek正式上线并开源了V4系列的预览版。之前圈子里各种猜测——参数量多大、上下文多长、是不是跳票了——这次总算有了确切答案。我从上午刷到消息就开始折腾,到现在用了大半天,趁热写点东西,一方面是帮还没上手的朋友梳理一下这代模型的核心变化,另一方面也分享一下实际使起来的体验,有好有坏,不吹不黑。

先说说V4到底是个什么东西

这次发布的V4不是一个模型,而是一个系列,分Pro和Flash两个版本。简单理解的话——Pro是大杯,Flash是小杯。

规格上一目了然:Pro版总参数1.6万亿,激活参数490亿;Flash版总参数2840亿,激活参数130亿。两版都支持100万token的超长上下文,并且同时支持非思考模式和思考模式,思考模式下可以调 `reasoning_effort`(设成low/medium/high)。Flash版能让你用接近Pro版的推理能力,速度更快,成本更低。另外值得注意的一点:DeepSeek这次的训练框架从英伟达迁移到了华为昇腾,成为全球首个跑在国产算力底座上的万亿参数级模型。

性能怎么样,说实话

评测数据看起来确实不错。官方数据显示,Pro版在Agent能力、世界知识和推理性能上达到了开源模型的前列,表现可以比肩顶级闭源模型。在Agentic Coding评测里,Pro版已经是开源模型里最好的,内部员工用下来的感受是体验优于Anthropic的Sonnet 4.5,代码交付质量接近Opus 4.6非思考模式,但和Opus 4.6思考模式比还有差距。世道知识方面,大幅领先其他开源模型,只比闭源的Gemini-Pro-3.1稍逊一筹;数学、STEM、编程竞赛这些推理任务上,Pro版超越了所有已公开评测的开源模型。不过DeepSeek自己也很克制,没吹得太离谱,坦言整体上跟Gemini比还差了大约3到6个月。

实际用一个下午的感受也很直接:交互速度明显快,100万token上下文的响应延迟控制得不错。试了试往对话里丢一本PDF小说的全文,上下文保持质量确实有提升,没有出现明显的”忘前文”现象。这个提升主要得益于V4的核心创新——一种新的注意力机制,在token维度上做压缩,结合自研的DSA稀疏注意力技术,大幅降低了计算开销和显存占用。不过多轮对话的时候,长上下文偶尔还是会有轻微”漂移”的感觉,我个人建议讨论到一定长度后重开一个会话,体验会比一直续接要好。

Agent能力是我实测下来最明显的提升。我折腾了一下午让它调用各种工具链完成任务,发现它在多步骤推理和工具调用上的稳定程度进步很明显,尤其是在写代码时对上下文的理解更准了,不太容易干到一半就忘了前面说过什么。不过如果你用的是Claude Code这类重度编程工具,**subagent模式下Flasha版能力不足,复杂推理建议锁定Pro版**,Flash更适合轻量级任务,让两个版本各司其职。

怎么用起来?三种方式,门槛都不高

V4的使用入口主要有三个:网页端、手机App、API。另外它还兼容Claude Code等主流Agent工具。

网页端

最简单。打开浏览器访问 chat.deepseek.com,登录后在模型列表里选V4就行。输入框上方能看到”快速模式”和”专家模式”两个入口——快速模式走的是V4-Flash,适合日常聊天、简单问答;专家模式走的是V4-Pro,适合复杂的推理任务。这个模式切换是4月8号App改版时上线的,当时很多人猜到了背后是对应两个模型,V4发布后算是确认了。

手机App

也一样舒服。去应用商店搜”DeepSeek”,认准开发者是”深度求索”就行。登录后功能和网页端基本一致。提醒一下:V4的百万上下文功能需要App更新到1.7.4或更高版本才能体验,如果版本太老可能只有老模型可用。

API接入

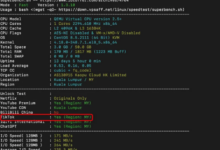

是给开发者的。先去 platform.deepseek.com 注册账号,获取API Key。新账号一般有500万免费token额度,够你测试用了。调用方式几乎零成本迁移——如果你之前用的是OpenAI或Anthropic格式,只需要改两个地方:base_url指向 `https://api.deepseek.com`,model名称改成 `deepseek-v4-pro` 或 `deepseek-v4-flash`。老模型的兼容问题注意一下,原有的 `deepseek-chat` 和 `deepseek-reasoner` 这两个模型名将于7月24日弃用,分别对应V4-Flash的非思考模式和思考模式,如果你的线上还在用旧的,得开始规划迁移了。

Claude Code用户

有专属的对接方案。把环境变量里 `ANTHROPIC_BASE_URL` 指向 `https://api.deepseek.com/anthropic`,`ANTHROPIC_MODEL` 设置成 `deepseek-v4-pro`,`ANTHROPIC_SMALL_FAST_MODEL` 设置成 `deepseek-v4-flash`。复杂代码和深度推理走Pro,轻量任务走Flash,还能改一行配置直接享受到比原版便宜几十倍的模型。

性价比和API价格

DeepSeek在API定价上延续了高性价比风格,按每百万token计价:Flash版输入缓存命中0.2元、未命中1元、输出2元;Pro版缓存命中1元、未命中12元、输出24元。网页端和App端仍然免费。另外官方提到Pro目前服务吞吐量有限,预计今年下半年昇腾950超节点批量上市后,Pro版价格会大幅下降。

| 模型 | 输入价格 | 输出价格 | 综合成本 | 相对DeepSeek V4 |

|---|---|---|---|---|

| DeepSeek V4 | ¥2 | ¥8 | ¥10 | 基准 |

| GPT-5.2/5.4 | ~¥14 | ~¥55 | ~¥69 | 贵7.2倍 |

| Claude Opus 4.6 | ¥35 | ¥173 | ¥207 | 贵21.7倍 |

| GPT-4.1标准版 | ¥14 | ¥55 | ¥69 | 贵7.2倍 |

一些需要注意的地方

说几个我觉得应该留意的点:

第一,预览版不算正式版。所谓”预览版”意味着模型还在持续打磨,后续可能会有架构调整和性能优化,API行为也可能有变动。

第二,Pro版没有多模态。和不少人的猜测不同,V4目前还是纯语言模型,不支持多模态理解和生成。原因是算力和资金有限,多模态训练被暂缓了。

第三,Pro版在需要深度链式推理的复杂场景中,跟Opus 4.6思考模式确实还有差距。如果你的场景对推理能力要求极高,建议实际测一下看看是否满足需求。

第四,上下文用量建议**关注计费**,尤其是API调用Pro版时,超长上下文的成本需要留意一下。

第五,DeepSeek目前正在开启首次外部融资,目标估值超过100亿美元,计划融资至少3亿美元用于训练更大参数规模的模型。团队人员也有一定流动,公司正在搭建更多产品团队来应对商业化和竞争压力。这就意味着DeepSeek正从纯技术研究机构向更商业化、更产品化的方向转型,这个变化可能会影响未来的产品策略和定价。

总的来说,想尝鲜的话现在就可以去 chat.deepseek.com 或下载App直接体验,免费、零门槛。开发者升级API几乎不用改代码,堪称无缝衔接。如果你想在Claude Code等工具上获得既强大又省钱的模型,直接用DeepSeek V4替代原生Claude API,Pro主力推理、Flash辅助轻任务,体验已经可以相当丝滑。

以上是我上手大半天的真实感受,后续深度长测发现更多亮点或者坑,我继续在这里更新。